OpenAI Whisper

OpenAI Whisper 是一个强大的自动语音识别 (ASR) 系统,旨在将语音信号转录为文本。以下是一些关于 Whisper 模型的重要信息:

1. 模型概述

Whisper 是由 OpenAI 开发的语音识别模型,具有高准确性和广泛的适用性。它能够处理多种语言和口音,适用于各种应用场景,如语音助手、字幕生成、会议记录等。

2. 主要特点

- 多语言支持:Whisper 支持多种语言和方言,能够处理不同语音输入。

- 高准确性:通过深度学习技术,Whisper 在语音转文本的准确性上表现出色,能够有效识别语音中的细微差别。

- 鲁棒性强:对背景噪音、不同说话者的音调和语速变化具有较好的适应能力。

- 开源和易于使用:Whisper 模型是开源的,开发者可以方便地下载和使用它,并且可以在多种编程语言和平台上集成。

3. 应用场景

- 语音助手:为智能语音助手提供准确的语音识别功能。

- 字幕生成:自动为视频和音频内容生成字幕,提升可访问性。

- 会议记录:实时转录会议内容,提高会议效率。

- 语言学习:帮助学习者通过语音识别技术进行发音练习和口语练习。

4. 技术实现

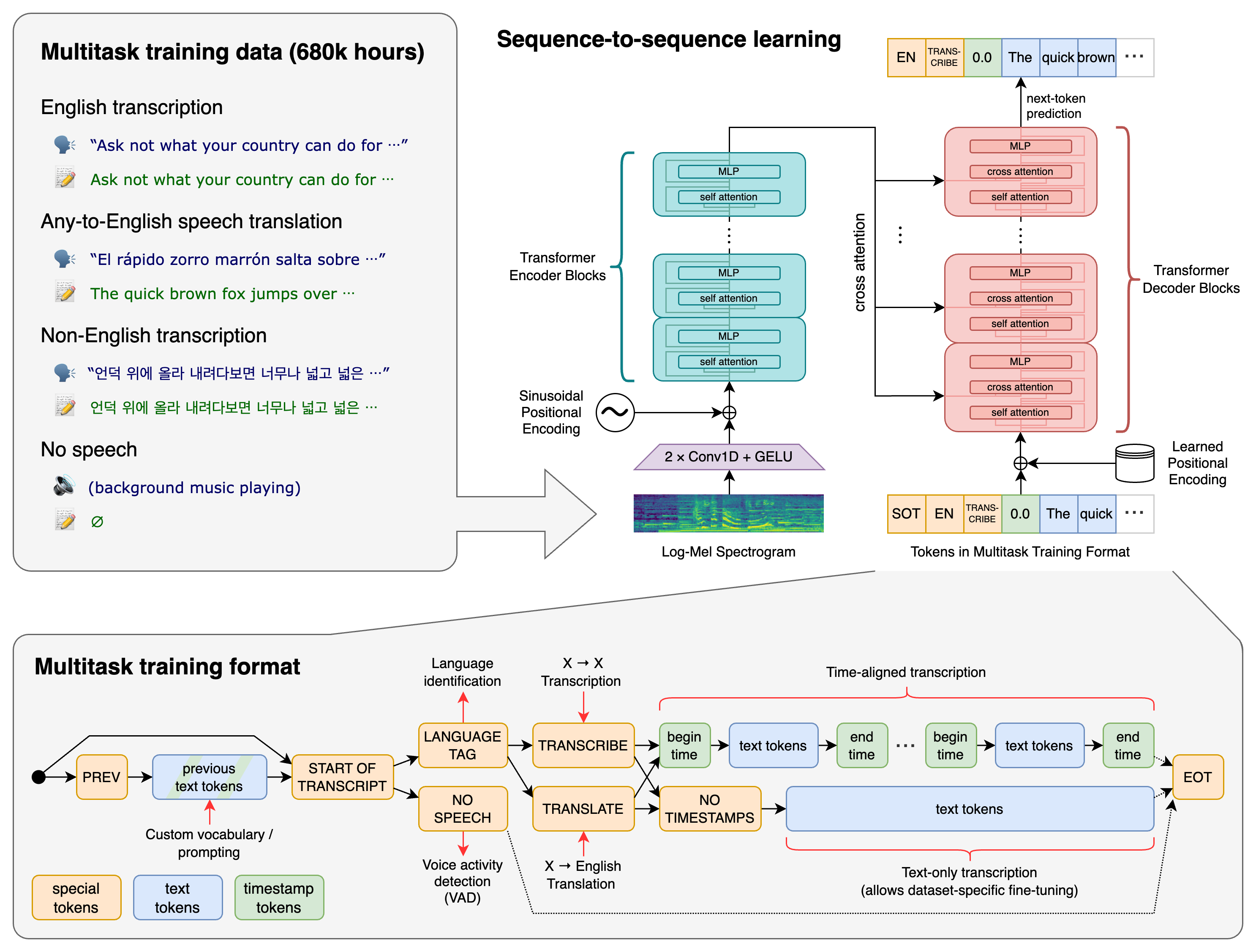

Whisper 使用了深度学习中的 Transformer 架构,通过大量的语音数据进行训练,能够有效捕捉语音信号中的时序信息和上下文信息。其核心技术包括:

- 语音特征提取:将原始语音信号转换为模型可以处理的特征向量。

- 序列到序列建模:将语音特征序列映射为对应的文本序列。

- 语言模型集成:结合语言模型提升转录结果的流畅性和连贯性。

5. 使用指南

- 安装和部署:开发者可以通过 pip 等包管理工具安装 Whisper 模型,并在本地或云端进行部署。

- API 调用:OpenAI 提供了便捷的 API 接口,开发者可以通过调用 API 进行语音识别任务。

- 模型调优:根据具体应用场景,开发者可以对 Whisper 模型进行微调,以获得更好的识别效果。

6. 优势与挑战

- 优势:高准确性、多语言支持、开源易用。

- 挑战:在嘈杂环境中仍可能出现识别错误,对特定领域的术语和专有名词需要进行额外训练和优化。

如果有进一步的需求,可以参考官方文档或社区资源,获取更多详细信息和使用指导。

7. 相关链接

以下是一些有助于进一步了解 OpenAI Whisper 模型的参考链接:

-

OpenAI Whisper 官方 GitHub 仓库:

-

Whisper 模型介绍和文档:

-

相关博客和文章:

-

Whisper 模型的使用示例:

-

Whisper API 文档:

通过这些链接,读者可以深入了解 OpenAI Whisper 模型的技术细节、使用方法以及实际应用场景。如果有更多问题,也可以访问 OpenAI 社区论坛,获取来自其他开发者的帮助和建议。